第 6 章是为分类进行微调。

作为例子给出的任务是构建垃圾邮件分类器。

垃圾邮件分类器需要判断一封邮件是不是垃圾邮件,因此输出结果要是类似 0、1 这样的值。

1. 微调的顺序

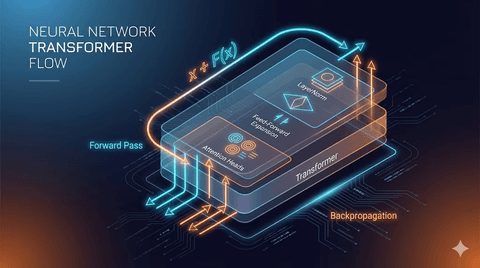

微调的过程和训练模型的过程很相似。

准备数据集,加载权重值,然后进行训练和评估。

稍微不同的一点是,会有一个把输出层映射到 0(非垃圾)和 1(垃圾)的过程。

在这样得到的张量中,基于包含信息最多的最后一个张量来输出是否为垃圾邮件。

最后使用交叉熵来计算损失。

2. 使用有监督学习数据对模型进行微调

将数据划分为训练数据和验证数据,通过多次 epoch 进行学习。

训练精度和验证精度保持接近,说明在训练和验证过程中表现出相似的精度。

也就是说,没有出现过拟合迹象。

现在就可以利用这个模型来区分垃圾邮件了。

3. 后记

我的 Mac mini 连跑 1.2B 模型都很吃力,但如果可能的话,总觉得如果能训练 LLM,就可以做很多事情。

也在考虑明年写论文的时候要不要用这个试一试。

得赶紧把书看完,然后再开始好好学 PyTorch。

댓글을 불러오는 중...