第6章は、分類のためのファインチューニングについてである。

例として出てくるのは、スパム分類器の作成。

スパム分類器は、あるメールなどがスパムかスパムでないかを分類するものなので、出力結果は 0 や 1 のような値になる必要がある。

1. ファインチューニングの手順

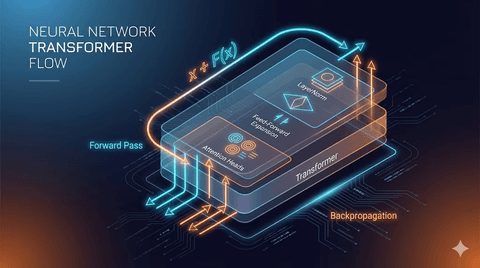

ファインチューニングのプロセスは、モデルを訓練するプロセスとよく似ている。

データセットを準備し、重みをロードしてから訓練し、評価する。

少し違う点は、出力層を 0(スパムではない)と 1(スパム)にマッピングする過程があること。

このように得られたテンソルのうち、最も多くの情報を含んでいる最後のテンソルに基づいて、スパムかどうかを出力するようにする。

最後に、損失はクロスエントロピーで算出する。

2. 教師あり学習データでモデルをファインチューニングする

データを訓練データと検証データに分け、これを複数エポックにわたって学習させる。

訓練精度と検証精度が近い状態で維持されているということは、訓練と検証の過程で似たような精度を示しているということだ。

これは過学習の兆候がないという意味である。

これで、これを使ってスパムを見分けることができるようになった。

3. 感想

自分のMac miniでは 1.2B を回すだけでもきついが、もし可能なら LLM を訓練していろいろなことができるのではないかと思う。

来年論文を書くときに、これを使ってみようかという気持ちにもなる。

早く本を読み終えて、そのあとは PyTorch を身につけていきたい。

댓글을 불러오는 중...